Moderne Verteidigung ist lernfähig und erkennt Täuschung auf semantischer, verhaltensbasierter und technischer Ebene – in Echtzeit.

DORA fordert Erkennung – nicht nur Reaktion. Von reaktiv zu proaktiv – das ist smarte Prävention und entspricht der regulatorisch geforderten Früherkennung (DORA).

Stärkung der letzten Verteidigungslinie geht einher mit kooperativem Trainieren von Mensch und Maschine.

Willkommen zurück! In Teil 1 – Die Bedrohung haben wir beleuchtet, wie künstliche Intelligenz (KI) für perfide Social-Engineering-Angriffe genutzt wird – von täuschend echten Deepfake-Calls bis zu manipulierten E-Mails. Im zweiten Teil zeigen wir, dass moderne Technologien wie Predictive Analytics, Machine Learning und Natural Language Processing (NLP) dabei helfen, diese Angriffe frühzeitig zu erkennen und erfolgreich abzuwehren.

Sichtbare Realität – unsichtbare Manipulation

Wie funktionieren Social-Engineering-Angriffe eigentlich? Die Antwort: durch gezielte psychologische Manipulation. Angreifer spielen mit Urvertrauen, Stress, Hierarchie- und Autoritätsgläubigkeit. Oft beginnt alles mit einer E-Mail, deren Betreff emotionalen Druck erzeugt – etwa durch Schlagworte wie „DRINGEND“ oder „Sofortige Aktion erforderlich“. Im Nachrichtentext folgt dann meist eine Aufforderung zur Zahlung oder Freigabe vertraulicher Daten.

Dank generativer KI sind solche Nachrichten heute so überzeugend formuliert, dass selbst geschulte Mitarbeitende sie nicht sofort als Angriff erkennen.

Noch raffinierter wird es, wenn zur angeblichen Verifizierung ein kurzes Telefonat oder ein Video-Call angeboten wird. Was dort gesprochen, gesehen und gefühlt wird, basiert häufig auf Deepfake-Technologie – inklusive Stimme, Mimik und Reaktion in Echtzeit. Das Ziel: Vertrauen erzeugen, wo Misstrauen angebracht wäre.

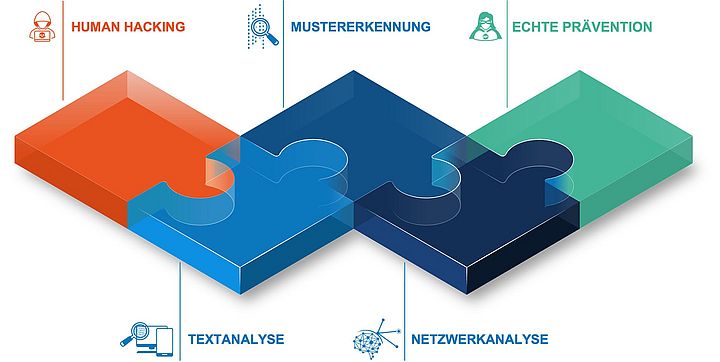

Wie ihr seht, ist die Bedrohung alles andere als theoretisch – doch ebenso greifbar ist die Technologie, die ihr etwas entgegensetzt. Denn moderne und zukunftsfähige Cybersecurity erfordert keine stärkeren, sondern intelligentere Schlösser! Genau hier beginnt die zweite Revolution der Künstlichen Intelligenz: KI als Schutzschild gegen Social-Engineering-Angriffe, CEO-Fraud, Phishing und sogar Insider-Handel.

Blockbuster wie Blade Runner oder Terminator sind nur Science-Fiction? Vielleicht. Doch zwischen Realität und Simulation liegt nur noch ein Klick – und unser digitales Spiegelbild denkt längst mit.

Smarte Prävention durch datengetriebene Systeme

Moderne Cybersecurity setzt auf Systeme, die aktiv lernen, analysieren und Muster erkennen. Machine-Learning-Modelle analysieren nicht nur technische Merkmale von E-Mails, sondern auch sprachliche und emotionale Signale. Sie erkennen, wenn sich Tonalität, Wortwahl oder Frequenz einer Kommunikation plötzlich verändern – ein potenzieller Hinweis auf eine Täuschung.

Predictive Analytics hilft, Kommunikationsverhalten im Unternehmen langfristig zu analysieren. Ziel ist es, potenzielle Bedrohungen vorherzusagen, bevor sie Schaden anrichten. Natural Language Processing (NLP) analysiert Inhalte semantisch – also über die reine Worterkennung hinaus – und identifiziert subtile Manipulationen oder emotionale Trigger in Texten.

Typische Muster – Beispiele aus der Praxis

- Insider-Risiken zeigen sich oft in neuen Kommunikationsbeziehungen zwischen Mitarbeitenden, die vorher keine Berührungspunkte hatten. Wenn gleichzeitig sensible Daten aufgerufen werden – besonders außerhalb der Arbeitszeiten – und das im zeitlichen Umfeld kritischer Marktbewegungen, kann dies auf eine koordinierte Vorbereitung von Insider-Handel hindeuten. KI-basierte Modelle identifizieren solche Beziehungsanomalien frühzeitig.

- NLP geht weit über die bloße Erkennung verdächtiger Begriffe hinaus und identifiziert übersteigerte Dringlichkeit, implizite Autorität und emotionale Appelle („Ich zähle auf dich – das ist Chefsache!“). Diese Hinweise werden systematisch eingeordnet und mit anderen Datenquellen verknüpft, sodass selbst raffinierte Täuschungsversuche aufgedeckt werden können, die menschlichen Prüfinstanzen oft entgehen.

- Echtzeit-E-Mail-Screening, kombiniert mit modernen Machine-Learning-Algorithmen, ist in der Lage, ungewöhnliche Schreibstile, IP-Adressen oder fehlende Sicherheitsmerkmale zu analysieren und auch feinste Abweichungen herauszuarbeiten. Solche E-Mails werden automatisch zur Verifizierung markiert. Das erhöht nicht nur die Erkennungsrate, sondern verhindert, dass täuschend echte Deepfake-Mails unbemerkt durchrutschen.

Kurz erklärt

- Consent-Phishing: Eine spezielle Phishing-Methode, bei der nicht Passwörter, sondern Zugriffsrechte erschlichen werden – etwa durch täuschend echte OAuth-Zugriffsanfragen.

- Cybercrime-as-a-Service: Der Vertrieb von Angriffstools und -diensten durch professionelle Anbieter im Darknet – inklusive Phishing-Kits, Fake-Websites und Deepfake-Generatoren.

- Adaptive Cybersecurity: Systeme, die sich auf Basis neuer Daten automatisiert weiterentwickeln – mit kontinuierlichem Lernen und situativem Verhalten.

DORA: Regulatorischer Druck als Innovationsmotor

Diese Methoden sind nicht nur technisch leistungsfähig – sie sind regulatorisch notwendig. Die EU-Verordnung DORA (Digital Operational Resilience Act) verpflichtet Finanzinstitute dazu, Bedrohungen frühzeitig zu erkennen und ihre Cyber-Resilienz systematisch zu stärken. Klassische Awareness-Kampagnen reichen dafür nicht mehr aus. KI-basierte Erkennungssysteme, automatisiertes Monitoring und adaptive Schutzmechanismen sind inzwischen regulatorischer Standard. Oder anders gesagt: Sie transformieren Schutz von reaktiv zu proaktiv.

Die Vorteile smarter Erkennung auf einen Blick

- Frühzeitige Warnung vor verdächtigem Verhalten

- Vermeidung von Compliance-Verstößen und Imageschäden

- Skalierbarkeit und Effizienz durch Automatisierung

- Echtzeitschutz durch kontinuierlich lernende Systeme

- Bessere Entscheidungsfähigkeit durch datenbasierte Mustererkennung

- Stärkung der Cyber-Resilienz, der Reputation und Vertrauenswürdigkeit

- Stärkung der letzten Verteidigungslinie dank kooperativem Trainieren von Mensch und Maschine

Quintessenz – Prävention statt Reaktion

KI ist nicht nur Werkzeug, sondern strategischer Partner im Kampf gegen Social Engineering, CEO-Fraud, Identitätsdiebstahl und Insider-Handel. Unternehmen, die heute auf smarte, datenbasierte Prävention setzen, sind morgen resilienter – technisch wie kulturell.

Die Zukunft der Cybersicherheit liegt in der richtigen und kontrollierten Anwendung von intelligenter Technologie. Ihr müsst also lernen, den digitalen Spiegel zu hinterfragen – und euch mit Technologien auszustatten, die Täuschungen in Echtzeit entlarven. Nur so lassen sich Cybercrime effektiv bekämpfen und Social-Engineering-Schutzmaßnahmen wirkungsvoll gestalten. Lasst uns gemeinsam das Fundament für nachhaltige Widerstandsfähigkeit legen, um Cybercrime das Handwerk zu legen.

Wenn ihr wissen wollt, wie moderne KI-gestützte Betrugsprävention in der Praxis konkret aussehen kann – kommt gerne auf uns zu. Wir bei PPI begleiten euch von der Analyse bis zur Umsetzung: praxisnah, kompetent und zukunftssicher.

Erfahrt mehr auf unserer Landingpage zur modernen KI-gestützten Betrugsprävention!